如何破解一张照片可实时视频换脸!警惕AI合成这种新型网络诈骗手段

随着AI技术的发展,利用AI换脸等新型诈骗手段层出不穷,尽管很多社交软件都设置了人脸识别的登录验证环节。然而,这一验证环节可能并不需要本人来操作。近日在湖北黄石就破获了一起用AI换脸技术解锁社交账号并倒卖获利的诈骗案。

前段时间,湖北黄石的王先生偶然进入某炒股直播间,王先生添加了直播间推送的社交账号后,跟对方一起进行股票投资。随着投资金额不断增加,当王先生想要提现时,发现对方的社交账号因涉嫌诈骗已被冻结,资金无法取出。于是王先生拨打了110,求助当地警方。

警方在侦办案件过程中,意外发现该涉案社交账号突然解冻并重新登录,推测可能有团伙帮助诈骗嫌疑人解封了账号。调查发现账号IP所在地在河南,黄石警方在当地配合下,很快抓获三名嫌疑人,现场查获13台电脑、9部平板、119部手机和80张电话卡。经讯问,高某与许某2023年9月底开始在网上贩卖和帮他人解锁社交账号,通过AI换脸融合的动态视频帮人解锁一些被平台冻结的交友账号。

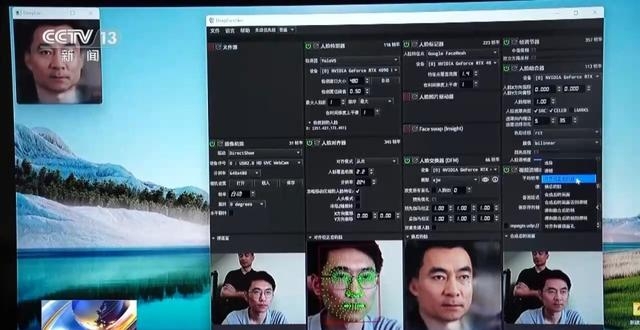

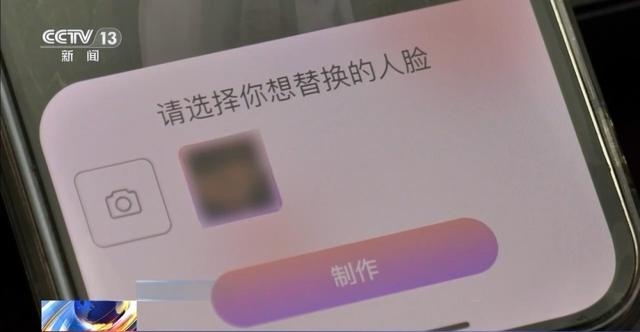

犯罪团伙通过自己在网上购买的一款视频合成软件,按照社交账号要求解封作认证的这些规定动作,利用他自己的人脸和他合成的那个视频,生成的AI视频上传到社交账号的后台,来进行认证。

据了解,这个团伙每解锁一个账号收费15元至30元不等,其中许多账号是因涉嫌诈骗被冻结的账号。该团伙共解冻了2107个账号,从中获利40万元。

一、如何破解新型诈骗手段,揭秘AI换脸技术背后的真相

我们常说“眼见为实”,但在AI时代,肉眼所见的也不一定是真相。一些不法分子利用“AI换脸”技术实施诈骗,已成为一种新型骗局。一张“肖像照片”、一段“貌似熟人的视频”,都可能被不法分子利用作为诈骗的手段和工具。

目前,社会上两种常用的AI换脸技术。通过一张事先从网络上公开获取的记者本人照片,经过一段时间的模型训练。这张照片就能在演示者的控制下像真人一样做出转头、张嘴、眨眼、微笑等表情和动作。

不法分子首先会通过各种公开的渠道获取受害人的个人肖像或视频,然后利用AI技术,对这些照片中的面容特征进行学习,从而模仿眨眼、摇头等动作,实现以假乱真的效果。

除了让照片上的人像活化,AI换脸技术还能实现在即时视频通信状态下的实时换脸。

目前所有用于AI换脸训练的照片和视频都是从网上公开收集的,犯罪分子主要通过一些公开的社交媒体平台,去拉取一些公共的视频。拿了这些数据,整体的训练时间差不多花了1天,24小时达到目前这个效果。总共只用了四五张照片和不到五分钟的素材。如果有充足的训练时间,仿真效果会更好。除了面容以外,声音也可以通过同样的技术来仿冒。专家指出,虽然目前AI换脸和仿声有一定的技术门槛和较高的实现成本,但如果被不法分子掌握,就可能在即时通信或者社交软件上伪装成他人,开展相应的诈骗活动。

利用AI技术制作换脸视频或合成声音来实施诈骗的确让人防不胜防,那么如何防范这种风险呢?

注重个人隐私信息保护

很多消费者困惑,随着AI技术的发展,各种新型诈骗手段防不胜防,如何能够避免被骗成为很多消费者关心的焦点。AI诈骗是隐私信息泄露与诈骗陷阱的结合,要加强对个人隐私的保护,不轻易提供人脸、指纹等个人生物信息给他人,不过度公开或分享动图、视频等,尤其涉及“朋友”“领导”等熟人要求转账、汇款的,务必通过多种途径核实确认,不要未经核实随意转账汇款。另外,我们在日常生活和工作中,尽量不要将自己的身份证号、身份证头像、手机号等自己的隐私信息在网上进行暴露,加强自己的隐私信息的保护。

利用AI换脸诈骗检测与预警技术来防止被骗

目前,上海帆石信息技术有限公司聚焦于人工智能生成内容检测领域,坚持“用AI治理AI,AI服务AI”的理念推出Ai检测产品安可小助手。针对Ai诈骗可以发挥重要作用,安可小助手凭借先进的技术和算法,能够对 AI 生成的文字、图片、视频、音频进行精准辨别,通过对大量数据的学习和分析,能够从语言模式、逻辑结构、信息来源等多个维度进行判断。比如,对于图像和视频,能检测出像素异常、画面拼接等痕迹,从而对可能是AI 生成内容进行预警,避免消费者陷入AI诈骗的陷阱。

加强AI技术应用的管理

AI换脸主要是使用深度合成技术。相关AI换脸应用企业应该按照《互联网信息服务深度合成管理规定》提交算法备案、安全评估的手段,要求深度合成服务提供者对深度合成的内容添加显式或隐式水印。合成图像或者照片添加水印的本质其实就是要一方面去提示公众这个内容是由AI生成或者合成的,另一方面也是要追溯它的来源。

随着科技进步,AI技术的应用日渐普遍,它在给我们带来更加便捷、高效的生活与工作方式的同时也给我们带来了新的困扰。面对AI合成这种新型网络诈骗手段,如何破解,任重而道远。